2024诺奖 |他们用物理学训练人工神经网络!

许多人都体验过计算机如何翻译不同的语言、解释图像,甚至进行合理的对话。可能不太为人所知的是,这类技术长期以来也对研究工作至关重要,比如对海量数据的分类和分析。

在过去的15到20年里,机器学习的发展呈现爆炸式增长,它利用的是一种被称为人工神经网络的结构。如今,当我们谈论"人工智能"时,通常指的就是这种类型的技术。

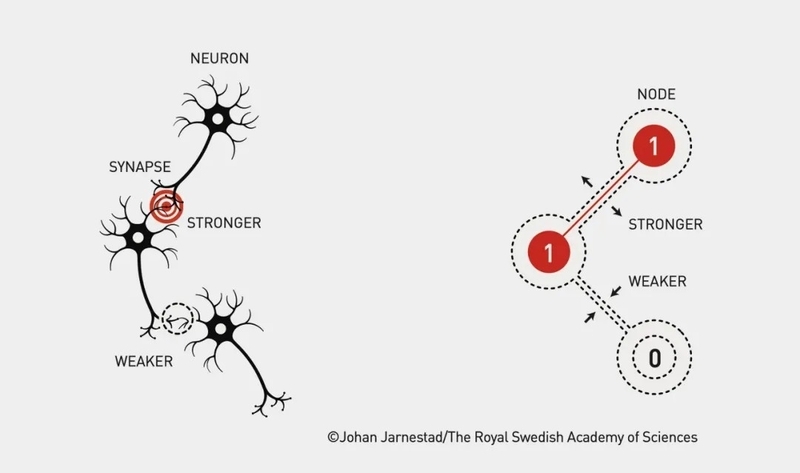

这项技术最初受到了脑结构的启发。在人工神经网络中,脑的神经元是由具有不同值的节点表示的。这些节点通过可以类比于突触的连接相互影响,而且这些连接可以加强或减弱。这种网络可以被训练,例如通过加强同时具有高值的节点之间的连接。

左:脑的神经网络是由具有复杂内部机制的活细胞(神经元)构建而成的。它们可以通过突触相互发送信号。当我们学习时,一些神经元之间的连接变得更强,而其他的则会变得更弱。右:人工神经网络是由编码了数值的节点构建而成的。这些节点相互连接,当网络接受训练时,同时激活的节点之间的连接变得更强,而其他的则变得更弱。

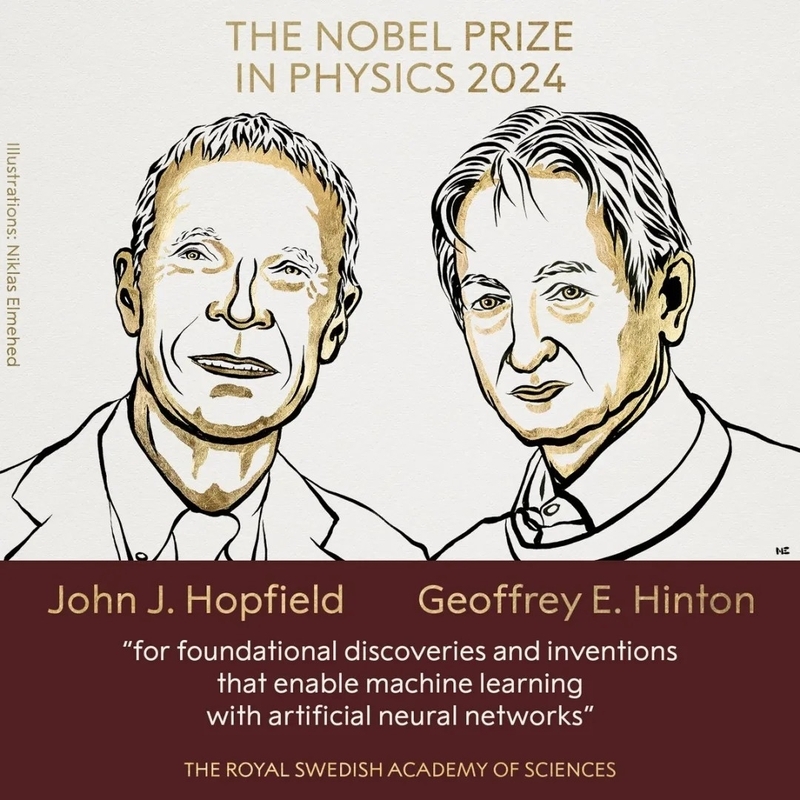

尽管计算机不能思考,但机器现在可以模仿记忆和学习等功能。这些功能在约翰·霍普菲尔德(John J. Hopfield)和杰弗里·辛顿(Geoffrey E. Hinton)的帮助下得以实现。他们从20世纪80年代开始就在人工神经网络方面开展了重要的工作。利用物理学的基本概念和方法,他们开发出了能利用网络结构来处理信息的技术。

他们也因此被授予2024年的诺贝尔物理学奖,以表彰他们"通过人工神经网络实现机器学习的基础性发现和发明"。

霍普菲尔德在1982年引入了“霍普菲尔德神经网络”,该网络利用了描述材料的原子自旋特性的物理学。整个网络是以等同于物理学中自旋系统能量的方式来描述的,并通过找到节点之间连接的值来进行训练,使得保存的图像具有低能量。当向霍普菲尔德神经网络输入一个畸变或不完整的图像时,它会系统地遍历节点并更新它们的值,这样网络的能量就会下降。如此一来,网络就能逐步找到与输入的不完美图像最相似的已保存图像。

辛顿以霍普菲尔德神经网络为基础,使用一种不同的方法创建了一个新网络——玻尔兹曼机。他利用的是统计物理学中的工具,这是一门由许多相似组件构建的系统科学。玻尔兹曼机是通过输入在其运行时很可能出现的示例来进行训练的。它可以学习识别给定类型数据中的特征元素,可用于对图像进行分类,或者创建与其训练模式类型相似的新示例。辛顿在此基础上进行了深入研究,帮助启动了当前机器学习的爆炸性发展。

诺贝尔物理学委员会主席Ellen Moons表示:"两位获奖者的工作已经带来了巨大的益处。在物理学中,我们在广泛的领域使用人工神经网络,例如开发具有特定性质的新材料。"

——转载自原理微信公众号2024年10月8日发布文章